来源:尚硅谷,Seven对其进行了补充完善

Kafka基础架构

在Kafka2.8版本前,Zookeeper的Consumer文件中存放消息被消费的记录(offset)

在Kafka2.8版本后,消息被消费的记录(offset)存放在Kafka中。

(1)Producer:消息生产者,就是向 Kafka broker 发消息的客户端。

(2)Consumer:消息消费者,向 Kafka broker 取消息的客户端。

(3)Consumer Group(CG):消费者组,由多个 consumer 组成。消费者组内每个消费者负责消费不同分区的数据,一个分区只能由一个组内消费者消费;消费者组之间互不影响。所有的消费者都属于某个消费者组,即消费者组是逻辑上的一个订阅者。

(4)Broker:一台 Kafka 服务器就是一个 broker。一个集群由多个 broker 组成。一个broker 可以容纳多个 topic。

(5)Topic:可以理解为一个队列,生产者和消费者面向的都是一个 topic。

(6)Partition:为了实现扩展性,一个非常大的 topic 可以分布到多个 broker(即服务器)上,一个 topic 可以分为多个 partition,每个 partition 是一个有序的队列。

(7)Replica:副本。一个 topic 的每个分区都有若干个副本,一个 Leader 和若干个Follower。

(8)Leader:每个分区多个副本的“主”,生产者发送数据的对象,以及消费者消费数据的对象都是 Leader。

(9)Follower:每个分区多个副本中的“从”,实时从 Leader 中同步数据,保持和Leader 数据的同步。Leader 发生故障时,某个 Follower 会成为新的 Leader。

安装部署

集群规划

集群部署

0)官方下载地址:http://kafka.apache.org/downloads.html

1)解压安装包

tar -zxvf kafka_2.12-3.0.0.tgz -C /opt/module/2)修改解压后的文件名称

mv kafka_2.12-3.0.0/ kafka3)进入到/opt/module/kafka 目录,修改配置文件

cd config/

vim server.properties输入以下内容:

#broker 的全局唯一编号,不能重复,只能是数字。

broker.id=0

#处理网络请求的线程数量

num.network.threads=3

#用来处理磁盘 IO 的线程数量

num.io.threads=8

#发送套接字的缓冲区大小

socket.send.buffer.bytes=102400

#接收套接字的缓冲区大小

socket.receive.buffer.bytes=102400

#请求套接字的缓冲区大小

socket.request.max.bytes=104857600

#kafka 运行日志(数据)存放的路径,路径不需要提前创建,kafka 自动帮你创建,可以配置多个磁盘路径,路径与路径之间可以用","分隔

log.dirs=/opt/module/kafka/datas

#topic 在当前 broker 上的分区个数

num.partitions=1

#用来恢复和清理 data 下数据的线程数量

num.recovery.threads.per.data.dir=1

#每个 topic 创建时的副本数,默认时 1 个副本

offsets.topic.replication.factor=1

#segment 文件保留的最长时间,超时将被删除

log.retention.hours=168

#每个 segment 文件的大小,默认最大 1G

log.segment.bytes=10737418244)分发安装包

xsync kafka/5)分别在 hadoop103 和 hadoop104 上修改配置文件/opt/module/kafka/config/server.properties中的 broker.id=1、broker.id=2

注:broker.id 不得重复,整个集群中唯一。

vim kafka/config/server.properties修改:

#The id of the broker. This must be set to a unique integer for each broker.

broker.id=16)配置环境变量

(1)在/etc/profile.d/my_env.sh 文件中增加 kafka 环境变量配置

sudo vim /etc/profile.d/my_env.sh#KAFKA_HOME

export KAFKA_HOME=/opt/module/kafka

export PATH=$PATH:$KAFKA_HOME/bin刷新环境变量

source /etc/profile启动

(1) Zookeeper启动 (默认守护进程)

./zkServer.sh startZookeeper状态

./zkServer.sh statusZookeeper停止

./zkServer.sh stopZookeeper客户端-常⽤命令

./zkCli.sh –server ip:port //连接ZooKeeper服务端

quit //断开连接(2) 启动Kafka

Kafka 守护方式 (环境变量配置前提下)

kafka-server-start.sh -daemon /home/environment/kafka/config/server.propertiesKafka关闭

kafka-server-stop.sh注意:停止 Kafka 集群时,一定要等 Kafka 所有节点进程全部停止后再停止 Zookeeper集群。因为 Zookeeper 集群当中记录着 Kafka 集群相关信息,Zookeeper 集群一旦先停止,Kafka 集群就没有办法再获取停止进程的信息,只能手动杀死 Kafka 进程了。

Kafka命令行操作

主题命令行操作

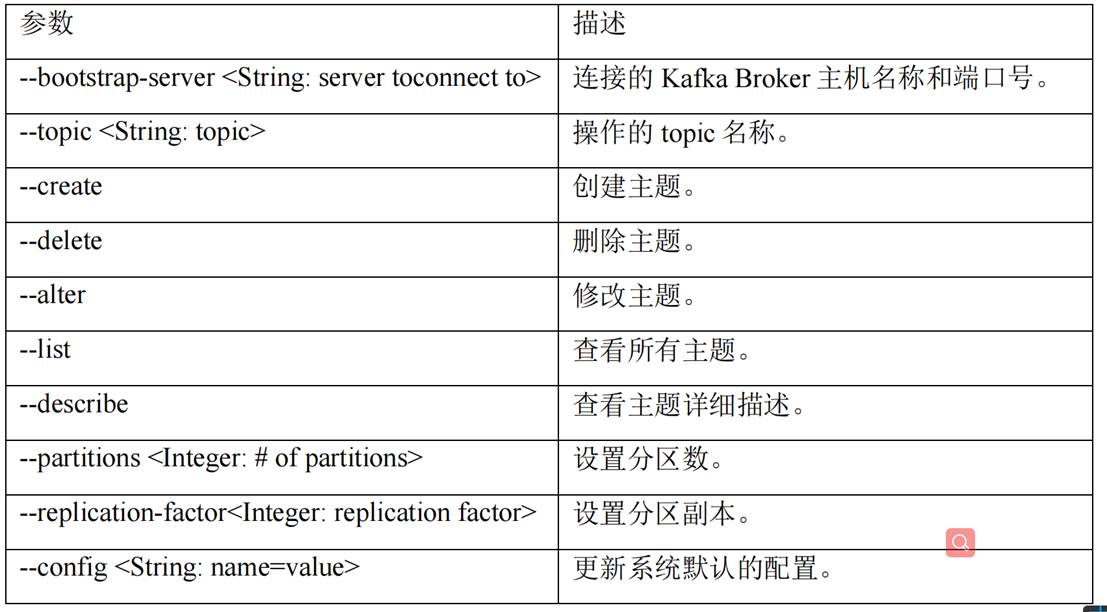

查看操作主题命令参数

bin/kafka-topics.sh

2)查看当前服务器中的所有 topic

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --list3)创建 first topic

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --create --partitions 1 --replication-factor 3 --topic first选项说明:

--topic 定义 topic 名

--replication-factor 定义副本数

--partitions 定义分区数4)查看 first 主题的详情

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --alter --topic first --partitions 35)修改分区数(注意:分区数只能增加,不能减少)

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --alter --topic first --partitions 36)再次查看 first 主题的详情

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --describe --topic first7)删除 topic(需要配置信息)

kafka-topics.sh --bootstrap-server 47.106.86.64:9092 --delete --topic first生产者命令行操作

1)查看操作生产者命令参数

连接kafka生产者

kafka-console-producer.sh --bootstrap-server 47.106.86.64:9092 --topic first参数 描述

--bootstrap-server <String: server toconnect to> 连接的 Kafka Broker 主机名称和端口号。

--topic <String: topic> 操作的 topic 名称。2)发送消息

bin/kafka-console-producer.sh --

bootstrap-server hadoop102:9092 --topic first

hello world

Hi HI消费者命令行操作

1)查看操作消费者命令参数

连接kafka消费者

kafka-console-consumer.sh参数 描述

–bootstrap-server <String: server toconnect to> 连接的 Kafka Broker 主机名称和端口号。

–topic <String: topic> 操作的 topic 名称。

–from-beginning 从头开始消费。

–group <String: consumer group id> 指定消费者组名称。2)消费消息

(1)消费 first 主题中的数据。

kafka-console-consumer.sh --bootstrap-server 47.106.86.64:9092 --topic first(2)把主题中所有的数据都读取出来(包括历史数据)。

kafka-console-consumer.sh --bootstrap-server 47.106.86.64:9092 --from-beginning --topic firstSpringBoot 整合Kafka

引入依赖

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

</dependency>SpringBoot生产者

修改 SpringBoot核心配置文件 application.propeties, 添加生产者相关信息

# 应用名称

spring.application.name =seven_springboot_kafka

# 指定 kafka 的地址

spring.kafka.bootstrap-servers =hadoop102:9092,hadoop103:9092,hadoop104:9092

指定 key 和 value 的序列化器

spring.kafka.producer.key-serializer =org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer =org.apache.kafka.common.serialization.StringSerializer创建 controller从浏览器接收数据 , 并写入指定的 topic

import org.springframework.beans.factory.annotation. Autowired;

import org.springframework.kafka.core.KafkaTemplate;

import org.springframework.web.bind.annotation. RequestMapping;

import org.springframework.web.bind.annotation. RestController;

@RestController

public class Producer Controller{

// Kafka 模板用来向 kafka 发送数据

@Autowired

KafkaTemplate<String, String> kafka;

@RequestMapping ("/kafkaproduce")

public String data (String msg ){

kafka.send("first", msg)

return "ok";

}

}SpringBoot消费者

修改 SpringBoot核心配置文件 application.propeties

# 指定 kafka 的地址

spring.kafka.bootstrap-servers =hadoop102:9092,hadoop103:9092,hadoop104:9092

# 指定 key 和 value 的反序列化器

spring.kafka.consumer.key-deserializer =org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.consumer.value-deserializer =org.apache.kafka.common.serialization.StringDeserializer

# 指定消费者组的 group_id

spring.kafka.consumer.group-id = atguigu创建类消费 Kafka中指定 topic的数据

import org.springframework.context.annotation. Configuration;

import org.springframework.kafka.annotation. KafkaListener;

@Configuration

public class KafkaConsumer {

// 指定要监听的topic

@KafkaListener(topics = "first")

public void consumeTopic(String msg) { // 参数: 收到的value

System.out.println("收到的信息: " + msg);

}

}